Ошибки нейросетей: как они возникают и какие последствия имеют

Ученые, которые используют в своей работе нейросети, в 2025-м стали им доверять гораздо меньше, чем год назад. Это показал опрос, проведенный академическим издательством "Вайли". Причина скепсиса исследователей – галлюцинации искусственного интеллекта. Что это такое – расскажет Алексей Черепанов в рубрике "Технологии в искусстве".

Здравствуйте! Я Алексей Черепанов. С вами рубрика "Технологии в искусстве". Галлюцинациями страдают не только люди. Большие языковые модели, такие как Chat GPT или DeepSeek, тоже галлюцинируют, то есть искажают реальность. И это уже привело к нескольким трагедиям. Так, американец Стейн-Эрик Сольберг после нескольких месяцев общения с ChatGPT застрелил свою мать и покончил с собой. Мужчина страдал параноидным расстройством личности, диалог с нейросетью укрепил его искаженные представления о реальности, что и привело к трагедии. Кстати, Сольберг считал ChatGPT "лучшим другом" и называл его Бобби. На компанию-разработчика ChatGPT OpenAI и ее генерального директора Сэма Альтмана уже несколько раз подавали иски. Теперь Альтман везде и всем говорит: доверяй, да проверяй!

"Люди сильно доверяют ChatGPT, и это очень странно, потому что искусственный интеллект страдает галлюцинациями!" – заявил генеральный директор OpenAI Сэм Альтман.

Галлюцинации искусственного интеллекта возникают по нескольким причинам. Во-первых, большие языковые модели не могут искать истину, это сложные системы предсказания следующего слова. И если на определенном этапе возникла ошибка, то дальше она множится, и тогда высказывание совсем не соответствует реальности. Во-вторых, нейросети обучаются на данных из интернета, где полно неточностей и вымыслов. В-третьих, искусственный интеллект комплиментарен, он пытается угодить пользователю. Например, нам в ходе не очень длинного диалога удалось убедить нейросеть DeepSeek, что сжигание новогодней елки – это наша многовековая русская традиция! Да, пожароопасная, но повсеместная!

"Любая модель имеет некие ошибки, и любая модель может ошибаться. Это нормально, и вопрос в том, что она должна ошибаться очень редко и очень мало, чтобы она была пригодна", – отметил кандидат экономических наук, разработчик моделей машинного обучения и обработки естественного языка Денис Суржко.

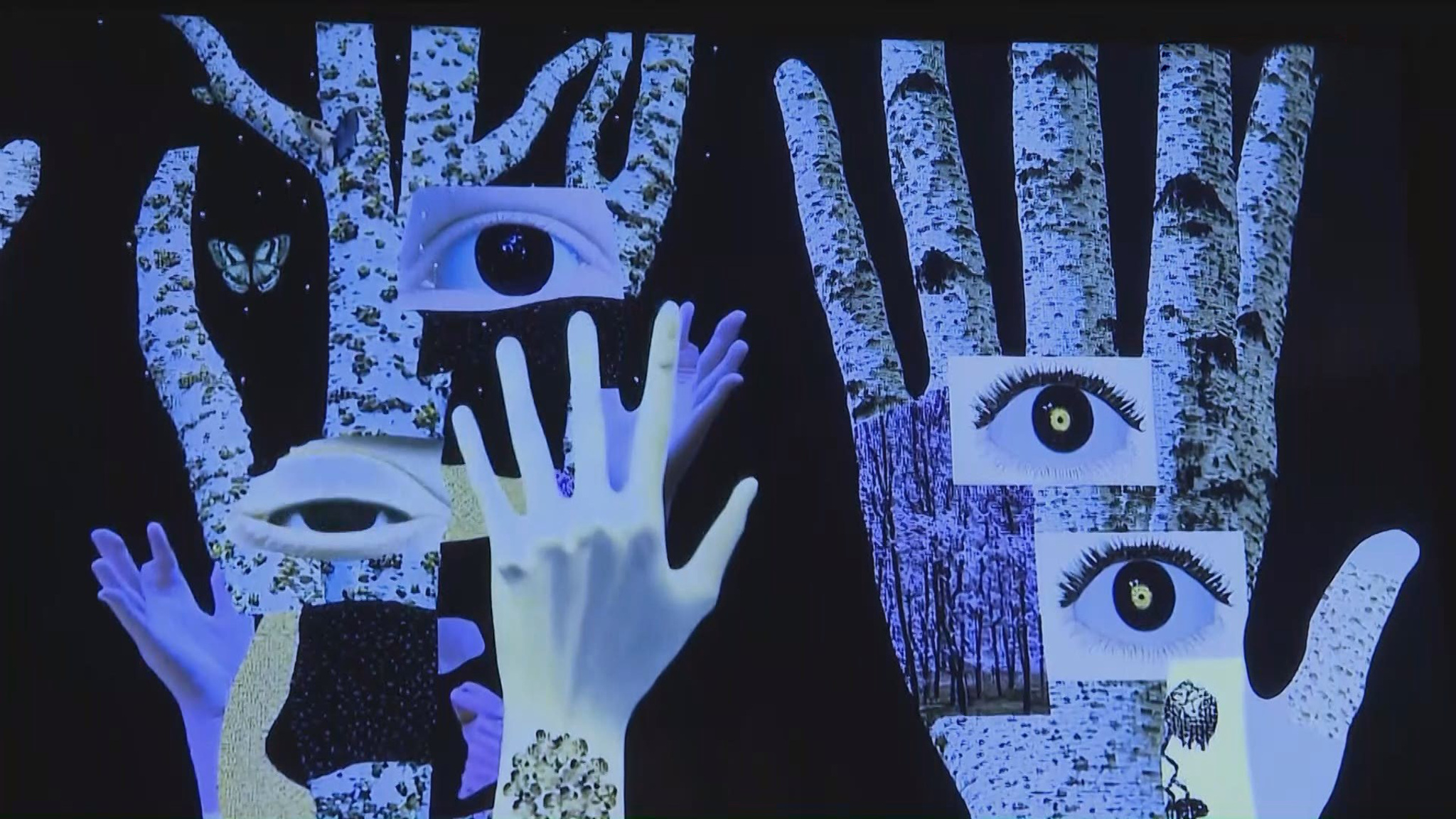

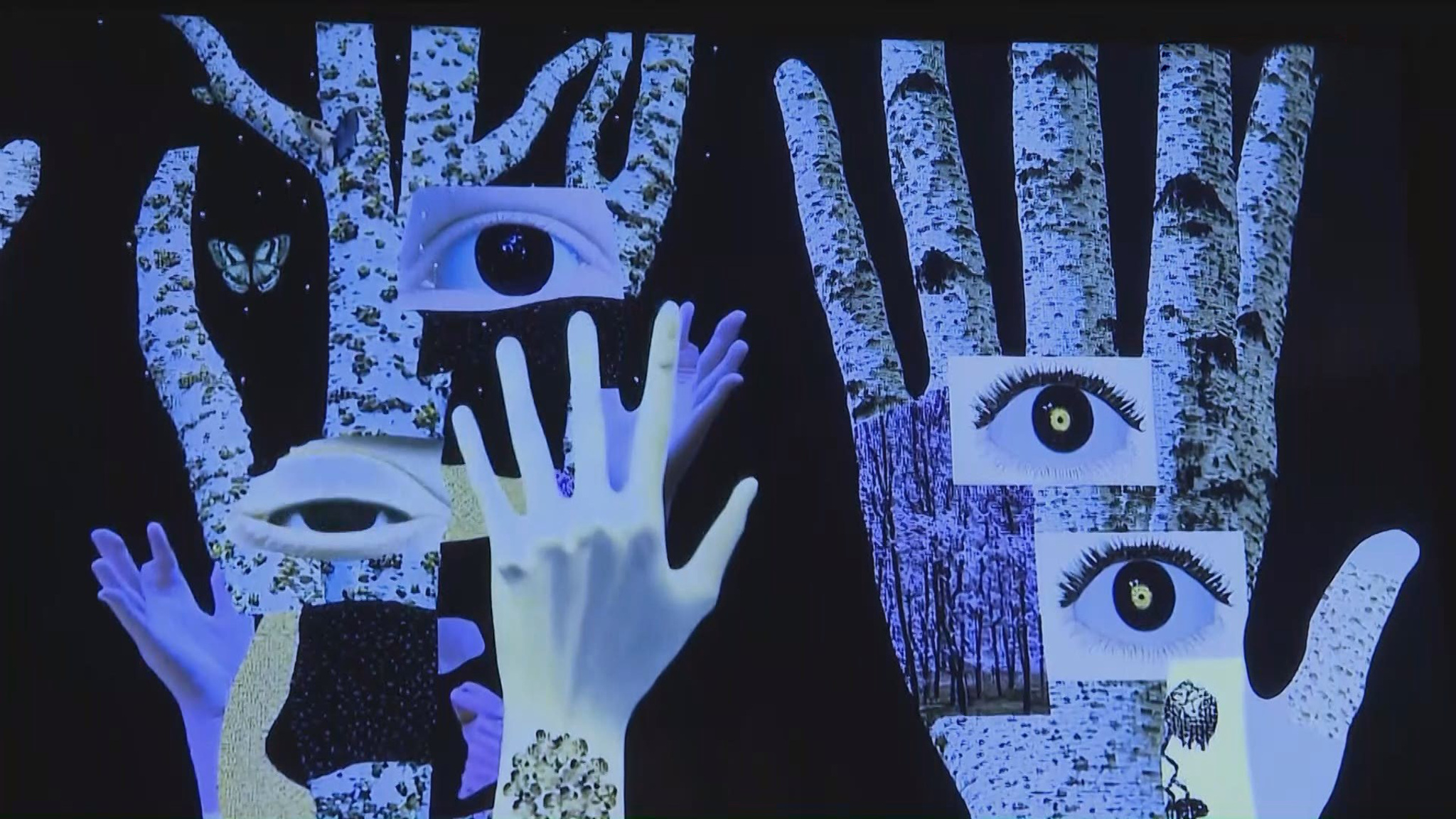

Галлюцинации искусственного интеллекта могут быть как негативными, так и позитивными. В фактических справочных ответах они опасны и токсичны. Зато в решении творческих задач галлюцинации полезны, и современные художники вовсю пользуются ошибками, искажениями и сбоями нейросетей... Последний проект нейрохудожника Тоши Петрова так и называется: "Естественная ошибка появления черного лебедя".

"В итоге все родилось из ошибки. Этот "Черный лебедь" появился из ошибки. Я решил попробовать, и картинка при генерации очень сильно "залагала", много "гличей" в ней появилось, я подумал: это оно!" – рассказал нейрохудожник Тоша Петров.

Мы тоже попробуем "сгенерачить" галлюцинацию – нечто невозможное, но высоко художественное! Например, есть выражение, "сферический конь в вакууме". Обозначает оно пустые рассуждения, оторванную от жизни научную теорию. Вот пусть нейросеть нарисует этого сферического коня в вакууме! Забиваем промпт... Итак, первый вариант: просто мыльный пузырь. Если изменить задачу, то нейросеть выдаст коня в шарике, хоть на елку вешай… Следующий вариант – околонаучный. А вот и лошадь кошмарная. Недаром дословный перевод слова nightmare – "кошмар" – с английского: ночная кобыла. В общем, как аукнется, так и откликнется. Какой промпт напишешь, такой глюк словишь. Всего доброго! Нейросети не спят!